Temperatur im Zusammenhang mit KI klingt harmlos, fast nebensächlich. Doch dieser kleine KI-Parameter entscheidet darüber, ob Du mit Deiner KI, also z.B. fokussierte Ergebnisse bekommst, kreative Überraschungen erlebst oder stundenlang im Kreis denkst, ohne jemals ans Ziel zu kommen. Die Temperaturschraube wirkt leise, aber tief und ist oft der Grund, warum die KI plötzlich abschweift, übertreibt oder sogar Unsinn erzählt.

Was viele nicht wissen: Temperatur ist mächtiger als jeder Prompt-Tipp. Sie kann aus nüchternen Fakten fantasievolle Wortgebilde machen oder kreative Ideen durch strenge Logik abwürgen. Wer sie nicht versteht, verliert schnell den Überblick oder wundert sich über die sprunghaften Launen der KI. Wer sie aber klug einsetzt, steuert die Richtung, den Stil und sogar den Tiefgang der Antworten. In diesem Blogpost zeige ich Dir, was es mit der Temperatur wirklich auf sich hat, wie sie auf Deine Ergebnisse wirkt, warum Du sie nicht unterschätzen solltest – und wie Du sie auch dann nutzen kannst, wenn Du sie scheinbar gar nicht einstellen kannst.

Inhaltsverzeichnis

- Was ist Temperatur? Eine einfache Erklärung für ein mächtiges Detail

- Kurzer Exkurs: Warum Temperatur etwas mit Wahrscheinlichkeiten zu tun hat

- Die technische Auswirkungen von Temperatur auf die Ausgabequalität von KI:

- Empfohlene Temperaturen für verschiedene KI-Anwendungen:

- Sprachübersetzung (T: 0,3 – 0,5)

- Kreatives Schreiben (T: 0,7 – 0,9)

- Datenanalyse (T: 0,2 – 0,4)

- Bildgenerierung (T: 0,6 – 0,8)

- Service-Chatbots (T: 0,4 – 0,6)

- Bildungswerkzeuge (T: 0,3 – 0,5)

- Praktische Beispiele zur direkten Umsetzung:

- 1. Praxisbeispiel: Kreatives Storytelling mit hoher Temperatur

- 2. Praxisbeispiel: Sachliche Nachrichten-Zusammenfassung mit niedriger Temperatur

- 3. Praxisbeispiel: Lerninhalte anpassen mit variabler Temperatur

- Alles hat zwei Seiten: Einschränkungen und Missverständnisse

- Beschränkungen

- Missverständnisse

- Expertentipps: Wie Du Deine Ziel dennoch erreichst – auch wenn Du sie nicht einstellen kannst

- Fazit:

- Author

Was ist Temperatur? Eine einfache Erklärung für ein mächtiges Detail

Du kannst Dir Temperatur in der KI wie einen kleinen Regler vorstellen, der bestimmt, wie vorsichtig oder wie kreativ Deine KI antwortet. Sie verändert nicht den Inhalt, den die KI kennt – sondern den Stil, mit dem sie daraus eine Antwort baut.

Nehmen wir ein Beispiel: Du hast einen sprechenden Roboter. Wenn Du seine Temperatur ganz niedrig einstellst, spricht er sachlich, knapp und ziemlich vorhersehbar. Er sagt genau das, was die meisten sagen würden, wenn sie ganz sicher gehen wollen. Du bekommst eine Antwort, die korrekt klingt – aber vielleicht ein bisschen langweilig, emotionslos und sachlich.

Drehst Du die Temperatur hoch, wird der Roboter mutiger. Er nutzt mehr Adjektive, erzählt vielleicht kleine Anekdoten, probiert verschiedene Sprachstile aus, bleibt nicht beim Thema, nutzt emotionale Phrasen und überrascht Dich auch mal mit einem originellen Reaktionen. Der Roboter aus unserem Beispiel erlaubt sich so einfach mehr Spielraum, auch wenn er damit über das Ziel hinausschießt und große Unterschiede in seinen Reaktionen hat.

Genauso ist das bei GenAI-Tools – bei KI-Temperatur geht es nicht um physische Wärme, sondern um Parameter in den AI-Algorithmen, die die Zufälligkeit bzw. den Determinismus (hohe Regeltreue) im Generierungsprozess beeinflussen.

Die Temperaturskala geht meistens von 0 bis 1. Ganz unten (bei 0) ist die KI maximal vorsichtig, fast schon technokratisch, sie führt zu vorhersehbareren und genaueren Ergebnissen, Ganz oben (bei 1) ist sie so offen, dass sie manchmal Dinge erfindet, weil sie sich für eine unerwartete Formulierung und für Vielfalt und Varianz entscheidet bzw. was jedoch möglicherweise auf Kosten von Kohärenz, Fakten oder Genauigkeit geht. Die Kunst liegt im Dazwischen – dort, wo Antworten interessant werden, aber trotzdem noch zum Thema passen.

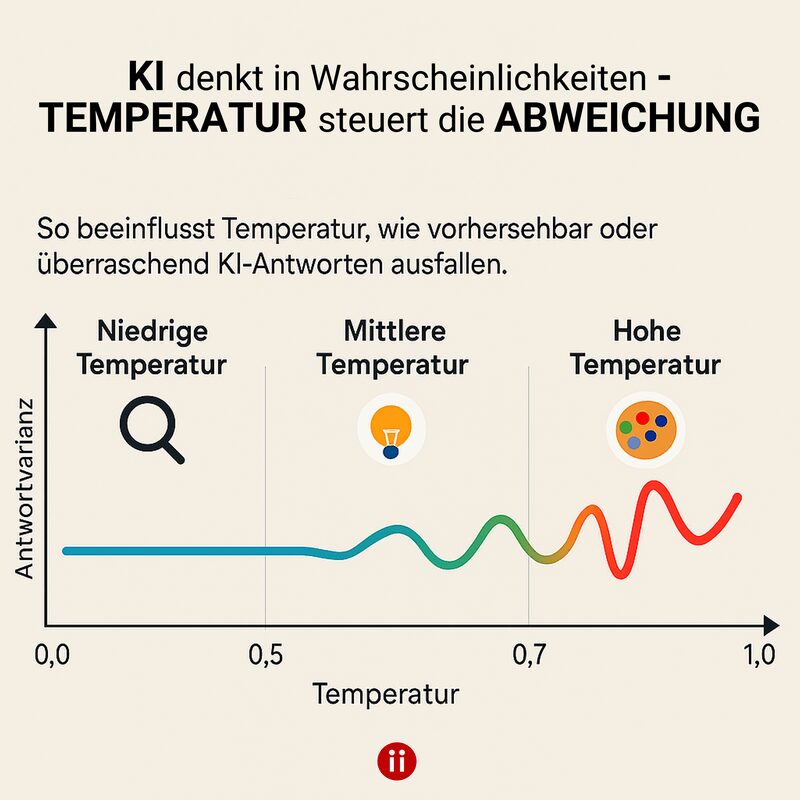

Kurzer Exkurs: Warum Temperatur etwas mit Wahrscheinlichkeiten zu tun hat

Wenn Du mit einer generativen KI wie ChatGPT arbeitest, wirkt es oft so, als würde sie die Antwort „wissen“. In Wirklichkeit funktioniert das aber ganz anders: Die KI rechnet nicht mit Fakten, sondern mit Wahrscheinlichkeiten. Sie überlegt nicht, sondern berechnet bei jedem Schritt, welches Wort statistisch gesehen am besten als Nächstes passen könnte. (mehr dazu hier)

Diese Berechnung basiert auf Mustern aus Millionen von Texten, die das Sprachmodell beim Training analysiert hat. Für jedes nächste Wort prüft die KI viele mögliche Varianten – manche sehr wahrscheinlich, andere eher selten. Die Temperatur steuert dann, wie stark sich die KI an die besonders wahrscheinlichen Wörter hält oder ob sie auch ungewöhnlichere Varianten zulässt.

Wenn wir das nun mit der KI-Temperatur verbinden:

Bei niedriger Temperatur wählt die KI fast immer die wahrscheinlichste Fortsetzung. Das führt zu klaren, aber oft vorhersehbaren Antworten. Das wird gern verwechselt mit “richtigen” Antworten, doch die korrekte Antwort ist “wahrscheinlichste” Antworten.

versus

Bei hoher Temperatur greift sie auch zu selteneren Ausdrücken, emotionalen Formulierungen, sie weicht von dem “Wahrscheinlichen” ab. Dadurch erhalten die Antworten mehr Varianz, der Fachbegriff in der KI-Welt ist: Die Antworten werden “kreativer”. (Das ist nicht direkt mit unserer menschlichen Kreativität vergleichbar.) In unseren Welt heißt das: Sie werden ungenauer oder manchmal unpassend.

Temperatur kann also nicht nur den Tonfall beeinflussen, sondern auch die inhaltliche Ausgabe und wie sie sich vom Thema entfernt. Je höher sie ist, desto mehr Freiheit hat die KI, vom Erwartbaren abzuweichen, und desto mehr musst Du als Nutzer darauf achten, ob die Antwort noch wirklich zur Frage passt. Wer das versteht, kann besser einschätzen, warum die Antworten manchmal nüchtern und ein andermal überraschend klingen, warum die KI manches Mal etwas dazu erfindet (halluziniert), obwohl die Frage dieselbe war.

Die technische Auswirkungen von Temperatur auf die Ausgabequalität von KI:

Die Temperatureinstellung ist also entscheidend für die Balance zwischen der Varianz der Antwort und Genauigkeit bezogen auf die Anfrage bei AI-Antworten. In Sprachmodellen und GPT-Modellen, einschließlich ChatGPT und Claude, beeinflusst die Temperatur die Satzvervollständigung, kreatives Schreiben und sogar faktische Antworten.![]()

Zum Beispiel nutzen Generative Adversarial Networks (GANs) und GenAI-Sprachmodelle die Temperatur, um das Gleichgewicht zwischen neuartigen, kreativen Ausgaben und kohärenten, sachlichen Ausgaben feinzustimmen.

Empfohlene Temperaturen für verschiedene KI-Anwendungen:

Die Auswahl der geeigneten Temperatur hängt von dem gewünschten Ergebnis ab. Für Aufgaben, die Genauigkeit und sachliche Korrektheit erfordern, wie zum Beispiel maschinelle Übersetzung oder Datenanalyse, wird eine niedrigere Temperatur bevorzugt.

Im Gegensatz dazu können bei kreativen Unternehmungen wie dem Schreiben von Geschichten oder der Erstellung von Kunstwerken mit Tools wie Midjourney oder AI-Videotools höhere Temperaturen zu innovativeren und vielfältigeren Ergebnissen führen.

Sprachübersetzung (T: 0,3 – 0,5)

Für maschinelle Übersetzungen sorgt eine moderate Temperatur für Genauigkeit und ermöglicht gleichzeitig sprachliche Flexibilität. Diese Einstellungen in der künstlichen Intelligenz. Algorithmen Hilfe bei der Balance zwischen der Notwendigkeit für präzise Übersetzungen und den Feinheiten der Sprache.

Kreatives Schreiben (T: 0,7 – 0,9)

Kreatives Schreiben profitiert von höheren Temperaturen in KI-Modellen. Diese Einstellung in Sprachmodellen wie ChatGPT oder Claude fördert die Kreativität und produziert vielfältige und einfallsreiche Textausgaben.

Datenanalyse (T: 0,2 – 0,4)

In der Datenanalyse garantiert eine niedrigere Temperaturregelung in KI-Tools eine hohe Genauigkeit, eine wesentliche Eigenschaft für sachliche und zuverlässige Ergebnisse.

Bildgenerierung (T: 0,6 – 0,8)

Für KI-Anwendungen in Bildgenerierung. Eine etwas höhere Temperatur fördert kreative Ergebnisse, was es AI-Modellen ermöglicht, mehr innovative und vielfältige visuelle Inhalte zu generieren.![]()

Service-Chatbots (T: 0,4 – 0,6)

Moderate Temperaturen in KI-Modellen wie ChatGPT stellen sicher, dass Kundenservice-Chatbots hilfreiche und relevante Antworten geben und gleichzeitig einen Gesprächston beibehalten.

Bildungswerkzeuge (T: 0,3 – 0,5)

In pädagogischen KI-Werkzeugen trägt eine ausgewogene Temperatureinstellung dazu bei, genaue Informationen auf ansprechende Weise bereitzustellen, die verschiedenen Lernstilen gerecht werden.

Praktische Beispiele zur direkten Umsetzung:

In praktischen Anwendungen werden Temperatur-Einstellungen in KI-Tools verwendet, um Ausgaben entsprechend den Benutzerbedürfnissen anzupassen. Zum Beispiel kann in der Bildgenerierung oder in kreativer Schreibarbeit eine höhere Temperatur eingestellt werden, um mehr einzigartige und vielfältige Ideen zu generieren. Im Gegensatz dazu sollten KI-Anwendungen in Bereichen wie rechtliche oder medizinische Texte niedrigere Temperaturen wählen, um eine höhere Zuverlässigkeit zu gewährleisten.

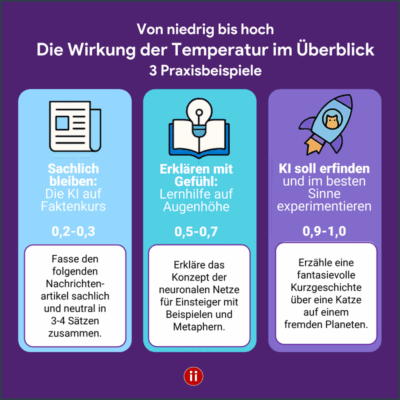

1. Praxisbeispiel: Kreatives Storytelling mit hoher Temperatur

Ziel: Erzeuge eine überraschende, kreative Kurzgeschichte mit einem GenAI-Tool, das Temperatur-Einstellungen unterstützt.

Arbeitsanweisung / Prompt:

„Erzähle eine fantasievolle Kurzgeschichte über eine Katze, die auf einem fremden Planeten landet und dort eine unerwartete Entdeckung macht. Die Geschichte soll überraschende Wendungen enthalten, ungewöhnliche Charaktere einführen und mit kreativen Ideen spielen. Verwende eine hohe Temperatur (z. B. 0.9 oder 1.0), um die Kreativität zu maximieren.“

Hinweis für den User:

Je höher die Temperatur, desto „mutiger“ wird das Modell bei der Wortwahl und beim Fortgang der Geschichte. Das führt zu mehr Überraschung, aber auch zu weniger Vorhersehbarkeit. Ideal für kreative Aufgaben wie Storytelling!

2. Praxisbeispiel: Sachliche Nachrichten-Zusammenfassung mit niedriger Temperatur

Ziel: Erzeuge eine prägnante, sachliche Zusammenfassung eines aktuellen Nachrichtenartikels mit einem GenAI-Tool, das Temperatureinstellungen unterstützt.

Arbeitsanweisung / Prompt:

„Fasse den folgenden Nachrichtenartikel sachlich und neutral in 3–5 Sätzen zusammen. Achte darauf, keine Meinungen oder Interpretationen hinzuzufügen. Verwende eine niedrige Temperatur (z. B. 0.2 oder 0.3), um eine konsistente und faktenbasierte Zusammenfassung zu erhalten.“

Hinweis für den User:

Niedrige Temperaturen führen zu deterministischeren und konsistenteren Ergebnissen. Das ist besonders nützlich bei Aufgaben, bei denen Genauigkeit und Informationsintegrität im Vordergrund stehen – wie bei der Zusammenfassung von Nachrichten.

3. Praxisbeispiel: Lerninhalte anpassen mit variabler Temperatur

Ziel: Erzeuge eine personalisierte Erklärung zu einem komplexen Thema, die sowohl sachlich korrekt als auch verständlich und ansprechend formuliert ist – abgestimmt auf den Lernstil der Zielperson.

Arbeitsanweisung / Prompt:

„Erkläre das Konzept der neuronalen Netze so, dass es für eine Person mit wenig technischem Vorwissen verständlich ist. Verwende eine mittlere Temperatur (z. B. 0.5–0.7), um eine Balance zwischen sachlicher Genauigkeit und anschaulicher, motivierender Sprache zu erreichen. Nutze Beispiele, Metaphern oder Vergleiche, um das Verständnis zu fördern.“

Hinweis für den User:

Eine mittlere Temperatureinstellung erlaubt es dem Modell, Inhalte lebendiger und individueller zu gestalten, ohne dabei die fachliche Präzision zu verlieren. So können Lerninhalte besser auf unterschiedliche Zielgruppen zugeschnitten werden – z. B. für Einsteiger, visuelle Lerntypen oder praxisorientierte Lernende.

Alles hat zwei Seiten: Einschränkungen und Missverständnisse

Wir müssen auch darüber sprechen, dass selbst Experten behaupten, ihre Einstellungen zu Temperatur ist die Lösung für ihre guten Ergebnisse. Das kann in Einzelfällen tatsächlich so sein. Aber: Obwohl die Temperatur ein mächtiges KI-Feature ist, ist es keine Lösung, die für alle Anwendungen gleichgeeignet ist.

Missverständnisse entstehen, wenn die Temperatur als alleiniger Bestimmungsfaktor der Leistung von KI angesehen wird. Dabei sind zwei Dinge zusätzlich entscheidend, Beschränkungen und Missverständnisse:

Beschränkungen

- Inkonsistenz bei hohen Temperatureinstellungen: Höhere Einstellungen können zu weniger konsistenten und zuverlässigen Ergebnissen führen, insbesondere bei Sprachmodellen und KI-Tools, die präzise Informationen erfordern.

- Übermäßige Abhängigkeit von der Temperatureinstellung: Sich ausschließlich auf Temperaturanpassungen in KI-Algorithmen zu verlassen, kann sehr inkonsistenten und sogar unverständlichen Antworten der KI führen.

- Schwierigkeit bei der Suche nach optimalen Einstellungen: Die Bestimmung der idealen Temperatur für bestimmte KI-Anwendungen, sei es bei der Satzvervollständigung oder der Bildgenerierung, kann herausfordernd und sehr zeitintensiv werden.

- Kompromiss zwischen Kreativität und Genauigkeit: Höhere Einstellungen könnten die faktische Ergebnistreue bei Ergebnisse mit hoher Varianz “kreativen Ergebnissen” in KI-Tools wie generative Sprachmodelle beeinträchtigen.

- Modellspezifische Variationen: Die Auswirkungen von Temperatur variieren je nach AI-Modell,

Missverständnisse

- Niedrige Temperaturen garantieren immer Genauigkeit. Niedrigere Temperaturen garantieren nicht in jeder KI-Anwendung Genauigkeit.

- Temperatur bestimmt Intelligenz. Die falsche Annahme, dass Temperatur-Einstellungen die Gesamtintelligenz einer KI widerspiegeln, ist irreführend. Aber sie hat manches Mal eine solche deutliche Auswirkung auf die (Formulierung des) Output, dass dieser nicht verständlich klingt.

- Temperaturanpassungen sind intuitiv und im Prompt nutzbar. Die Anpassung der Temperaturregelung in KI-Modellen, sei es in ChatGPT oder Claude, erfordert ein differenziertes Verständnis und ist nicht immer einfach.

- Eine Größe passt für alle. Die Annahme, dass eine einzige Temperatureinstellung für alle Aufgaben geeignet ist, von maschineller Übersetzung bis hin zum kreativen Schreiben, ist falsch.

- Höhere Einstellungen bedeuten bessere KI. Die Annahme, dass höhere Temperaturen grundsätzlich die Fähigkeiten von KI verbessern, übersieht die Bedeutung von Genauigkeit und sachlichen Ergebnissen.

Expertentipps: Wie Du Deine Ziel dennoch erreichst – auch wenn Du sie nicht einstellen kannst

In vielen KI-Anwendungen wie ChatGPT, Copilot oder Claude kannst Du die Temperatur nicht direkt einstellen. Trotzdem hast Du Einfluss darauf, wie „vorsichtig“ oder wie „kreativ“ die KI antwortet – über Deinen klugen und präzisen Prompt.

Wenn Du ChatGPT anweist:

„Antworte mit Temperatur 0,2“ oder

„Nutze eine Temperatur von 0,9 für diese Aufgabe“,

dann versteht das Modell zwar, was Du meinst – aber es stellt intern keine echte Temperatur um, es das technisch nicht kann.

Die tatsächliche Einstellung der Temperatur erfolgt systemseitig beim Start der Konversation oder beim Bauen eines Custom GPTs, nicht während eines einzelnen Chats. ChatGPT zum Beispiel nutzt in der normalen Nutzung eine fest voreingestellte Temperatur (bei GPT-4 meist 0,7), die Du nicht über einen Prompt verändern kannst.

Was aber möglich ist (und nur den Art der Antwort = den Output ändert):

Wie schon beschrieben. Du kannst im Prompt die Anweisung geben, welchen Output Du erwartest – so, als würdest Du sie steuern. Und richtig gemacht, funktioniert das auch ganz gut bezogen auf Deinen Output. Zum Beispiel:

-

„Bitte antworte sehr nüchtern, exakt, ohne Ausschmückungen.“ (entspricht einer niedrigen Temperatur)

-

„Antworte kreativ, nutze ungewöhnliche Formulierungen, erzähle frei, experimentiere.“ (entspricht einer hohen Temperatur)

Diese Art der Formulierung beeinflusst die Art der Antwort, auch wenn die Temperatur technisch gleich bleibt. Die KI interpretiert dann Deinen Wunsch – so wie sie auch andere Rollen oder Schreibstile interpretiert. Sie macht dann die Temperatur zu einem Ton, verhält sich aber technisch weiter gleich, z.B. was Interpretationsfähigkeit oder Sachlichkeit der Erarbeitung der Antwort bedeutet, inklusive Halluzination und anderer Fehler. Kurz: Du musst mit allen Einschränkungen rechnen, die Du nicht durch einen Prompt reduzieren kannst, aber wie wir wissen, müssen diese ja nicht unbedingt kommen, Du musst nur wachsam sein.

Wenn Du tatsächlich mit einer fest eingestellten Temperatur arbeiten möchtest, brauchst Du entweder:

-

ein Custom GPT, bei dem Du die Temperatur beim Erstellen festlegst, zum Beispiel im Systemprompt oder einem extra Style Sheet (Tipp: Geht am verlässlichste, wenn man die Anweisung in Englisch gibt oder in einen JSON-Code wandelt.)

-

Zugriff auf die API von OpenAI oder Claude, dort kannst Du die Temperatur im Code definieren und “übersetzen” (hier mit Code-Vorschlägen im IBM-KI-Blog)

In normalen GenAI-Chats kannst Du Temperatur also nicht direkt umstellen, aber Du kannst durch klug formulierte Prompts eine ähnliche Wirkung erzielen.

Fazit:

Temperatur ist kein technisches Detail am Rande, sondern ein zentrales Steuerinstrument in der Arbeit mit generativer KI. Sie entscheidet nicht über richtig oder falsch, aber sie beeinflusst spürbar, wie klar, wie kreativ oder wie verspielt – und damit oft auch verständlich – eine Antwort klingt – und wie nah die Antwort an Deiner Frage bleibt.

Wenn Du mit KI arbeitest, ohne die Temperatur zu verstehen, kann das schnell zu Frust führen. Mal wirken die Antworten zu trocken, mal zu ausschweifend, mal völlig neben dem Thema. Doch sobald Du verstanden hast, wie Temperatur funktioniert, kannst Du gezielter prompten – auch wenn Du sie nicht direkt einstellen kannst. Wer Temperatur klug nutzt, gewinnt einen Drehknopf für Ton, Tiefe und Ausdruck. Und das macht den Unterschied zwischen zufälligen Ergebnissen – und Antworten, die wirklich weiterhelfen.

Hinterlassen Sie einen Kommentar